诺贝尔奖获得者谈将人工智能作为工具而非拐杖使用 - Business Insider

12-28-2025

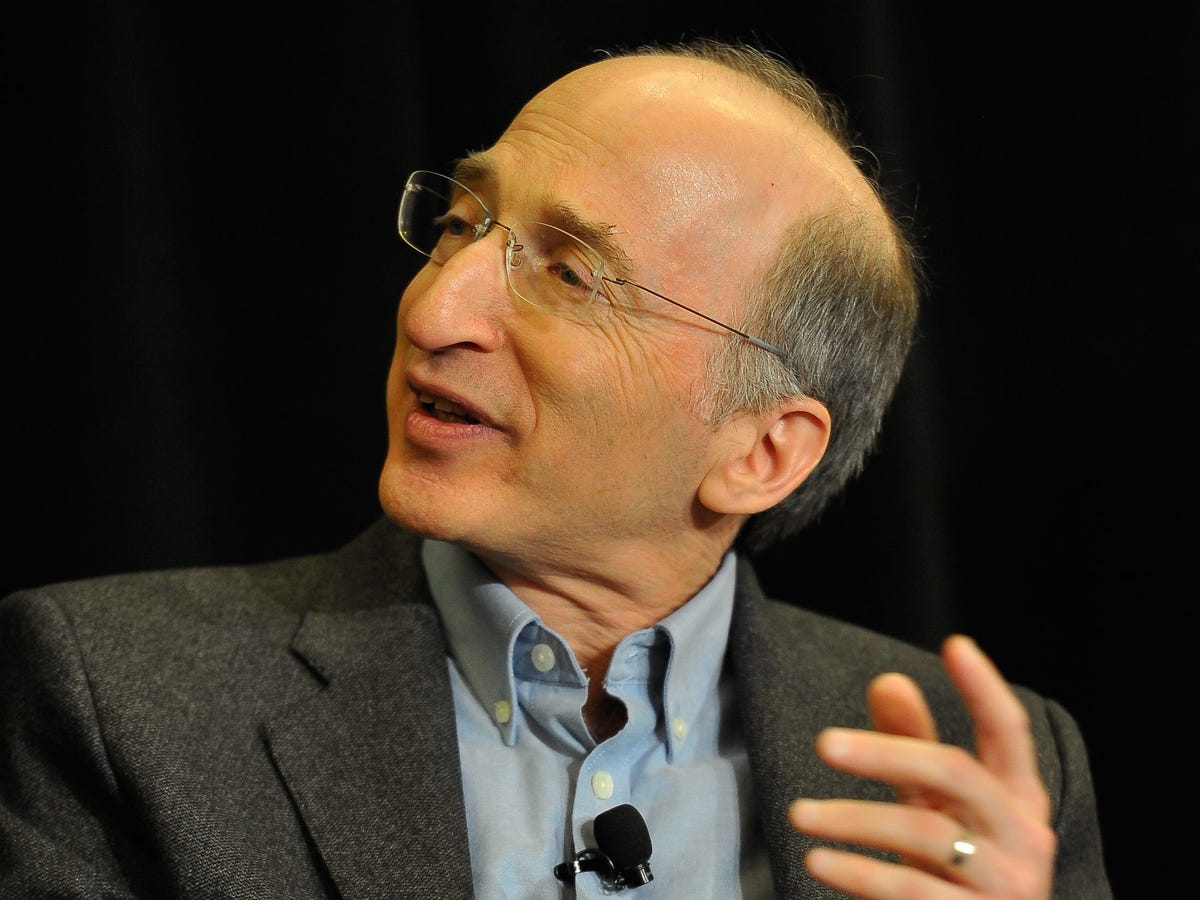

人工智能会让你更聪明吗?可能不会,诺贝尔物理学奖得主索尔·珀尔马特(Saul Perlmutter)如是说。他因发现宇宙加速膨胀而闻名。他表示,AI最大的危险在于心理层面:它可能让人们对自身不理解的事物产生误解,随着这项技术日益融入我们的日常工作和学习,人类的判断力反而会因此削弱。

"珀尔马特周三在与挪威银行投资集团首席执行官尼古拉·坦根(Nicolai Tangen)播客节目中表示:"AI棘手之处在于,它可能让你在真正掌握基础知识之前就产生了已经学会的错觉。"他补充道:"有一点危险是,学生们可能在学会如何独立进行智力工作之前,就过早地过度依赖AI。""

珀尔马特认为,与其完全拒绝AI,不如将其视为一种工具——一种辅助思考而非代替思考的工具。

珀尔马特表示,AI可以很强大——但前提是用户已经具备批判性思维能力。他说:"好处在于,当你了解所有这些不同的思维工具和方法时,AI通常能帮助你找到所需的信息。"

在珀尔马特任教的加州大学伯克利分校,他与同事们开发了一门以科学推理为中心的批判性思维课程,内容包括概率思维、错误检查、怀疑精神和结构化异议等,通过游戏、练习和讨论等方式教授,旨在使这些思维习惯在日常决策中自动化。他说:"我要求学生们认真思考如何利用AI使这一概念更容易实际应用——真正将其融入日常生活。"

珀尔马特的一个担忧是,AI常常表现出远超其实际应得的确定性,并且在陈述时可能"过于自信"。

珀尔马特表示,挑战在于AI自信的语气可能绕过人们的怀疑精神,使人们更可能不加质疑地接受其答案,而不是思考这些答案是否正确。

他说,这种自信反映了人类最危险的认知偏见之一:信任看似权威或符合我们既有信念的信息。

为了对抗这种本能,珀尔马特表示,人们应该以评估任何人类主张相同的方式来评估AI的输出——权衡其可信度、不确定性和出错的可能性,而不是不加思考地接受答案。

在科学领域,珀尔马特表示,研究人员会假设自己可能会犯错,并建立系统来捕捉这些错误。例如,他说,科学家会对自己隐藏研究结果,直到他们彻底检查完所有错误,从而减少确认偏见。

他补充说,同样的思维模式也适用于AI。他说:"许多[这些概念]只是思考我们在何处被欺骗的工具。我们可能自欺欺人,AI可能欺骗自己,然后又可能欺骗我们。"

他说,这就是为什么AI素养也包括知道何时不应信任输出结果——并且对不确定性保持舒适感,而不是将AI的输出视为绝对真理。

尽管如此,珀尔马特明确表示,这个问题没有永久性的解决方案。他说:"AI将不断变化,我们将不得不不断问自己:它是在帮助我们,还是我们更多地被欺骗了?是我们让自己被欺骗了吗?"

"珀尔马特周三在与挪威银行投资集团首席执行官尼古拉·坦根(Nicolai Tangen)播客节目中表示:"AI棘手之处在于,它可能让你在真正掌握基础知识之前就产生了已经学会的错觉。"他补充道:"有一点危险是,学生们可能在学会如何独立进行智力工作之前,就过早地过度依赖AI。""

珀尔马特认为,与其完全拒绝AI,不如将其视为一种工具——一种辅助思考而非代替思考的工具。

珀尔马特表示,AI可以很强大——但前提是用户已经具备批判性思维能力。他说:"好处在于,当你了解所有这些不同的思维工具和方法时,AI通常能帮助你找到所需的信息。"

在珀尔马特任教的加州大学伯克利分校,他与同事们开发了一门以科学推理为中心的批判性思维课程,内容包括概率思维、错误检查、怀疑精神和结构化异议等,通过游戏、练习和讨论等方式教授,旨在使这些思维习惯在日常决策中自动化。他说:"我要求学生们认真思考如何利用AI使这一概念更容易实际应用——真正将其融入日常生活。"

珀尔马特的一个担忧是,AI常常表现出远超其实际应得的确定性,并且在陈述时可能"过于自信"。

珀尔马特表示,挑战在于AI自信的语气可能绕过人们的怀疑精神,使人们更可能不加质疑地接受其答案,而不是思考这些答案是否正确。

他说,这种自信反映了人类最危险的认知偏见之一:信任看似权威或符合我们既有信念的信息。

为了对抗这种本能,珀尔马特表示,人们应该以评估任何人类主张相同的方式来评估AI的输出——权衡其可信度、不确定性和出错的可能性,而不是不加思考地接受答案。

在科学领域,珀尔马特表示,研究人员会假设自己可能会犯错,并建立系统来捕捉这些错误。例如,他说,科学家会对自己隐藏研究结果,直到他们彻底检查完所有错误,从而减少确认偏见。

他补充说,同样的思维模式也适用于AI。他说:"许多[这些概念]只是思考我们在何处被欺骗的工具。我们可能自欺欺人,AI可能欺骗自己,然后又可能欺骗我们。"

他说,这就是为什么AI素养也包括知道何时不应信任输出结果——并且对不确定性保持舒适感,而不是将AI的输出视为绝对真理。

尽管如此,珀尔马特明确表示,这个问题没有永久性的解决方案。他说:"AI将不断变化,我们将不得不不断问自己:它是在帮助我们,还是我们更多地被欺骗了?是我们让自己被欺骗了吗?"